GPT-5 : le grand saut « omni-thinking » d’OpenAI

OpenAI a officiellement présenté GPT-5 le 7 août 2025 : une plateforme unifiée qui combine plusieurs moteurs internes — un modèle « efficace » pour la plupart des requêtes, un moteur de raisonnement profond pour les problèmes difficiles, et un routeur temps réel qui choisit automatiquement le cœur le mieux adapté à la tâche. L’objectif affiché est clair : passer d’un assistant de conversation à un « cerveau numérique » capable de voir, écouter, coder et raisonner de façon plus rapprochée des usages humains.

Ce qui change vraiment avec GPT-5

Plutôt qu’un simple « GPT plus puissant », GPT-5 réorganise la manière dont les modèles sont utilisés :

-

Système unifié et routage intelligent : le système détecte la complexité d’une demande (par ex. « pensez-y sérieusement ») et bascule automatiquement vers le moteur qui va maximiser la qualité — rapidité pour les réponses courantes, raisonnement approfondi pour les tâches complexes. Cela évite à l’utilisateur de choisir manuellement un modèle.

-

Multimodalité renforcée : texte, image, audio et code peuvent être combinés dans une seule requête et traités de façon intégrée, ce qui rend l’IA plus utile pour des scénarios hybrides (analyse d’un document + explication orale + correction de code).

-

Versions pour développeurs : l’API propose plusieurs tailles —

gpt-5,gpt-5-mini,gpt-5-nano— afin que les équipes choisissent le meilleur compromis performance/coût/latence pour leurs applications.

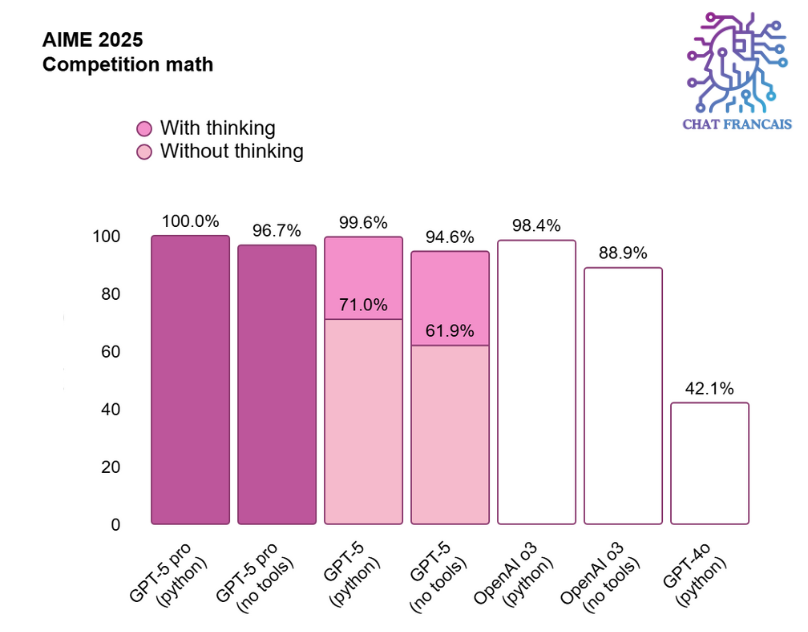

Précision, mémoire et fiabilité : des progrès tangibles

OpenAI met l’accent sur la réduction des erreurs factuelles (« hallucinations ») et sur une vérification interne des raisonnements avant restitution à l’utilisateur. Selon les documents publics et les notes de lancement, GPT-5 améliore sensiblement la fiabilité : meilleurs scores sur des tâches de codage, de mathématiques et d’analyse documentaire. Les gains annoncés incluent une réduction notable des hallucinations et une capacité accrue à admettre l’incertitude quand l’information manque.

Contexte et longueur de contexte : où en sommes-nous ?

GPT-5 étend fortement la capacité à « tenir en mémoire » de longs échanges ou des documents volumineux — un atout pour relire des livres, analyser de gros fichiers ou suivre de longues réunions. Les chiffres publiés et analysés par la presse indiquent des fenêtres de contexte très larges via l’API (jusqu’à plusieurs centaines de milliers de tokens en API), tandis que les limites pratiques dans l’interface ChatGPT peuvent être réduites selon les plans d’accès. En pratique, attendez-vous à des paramètres différents selon que vous utilisiez l’API, un compte gratuit, Plus ou Pro.

Cas d’usage concrets

GPT-5 se positionne comme un outil transversal pour :

-

la recherche & synthèse (rapports, analyses de corpus volumineux) ;

-

le développement logiciel (génération, revue et debugging de code à un niveau plus fiable) ;

-

la création de contenu (articles, scripts, storyboards multimodaux) ;

-

la santé et finance (pré-analyse documentaire et aide à la rédaction, avec garde-fous).

Les entreprises pourront intégrer GPT-5 via l’API ou en l’utilisant dans ChatGPT pour automatiser des workflows plus poussés.

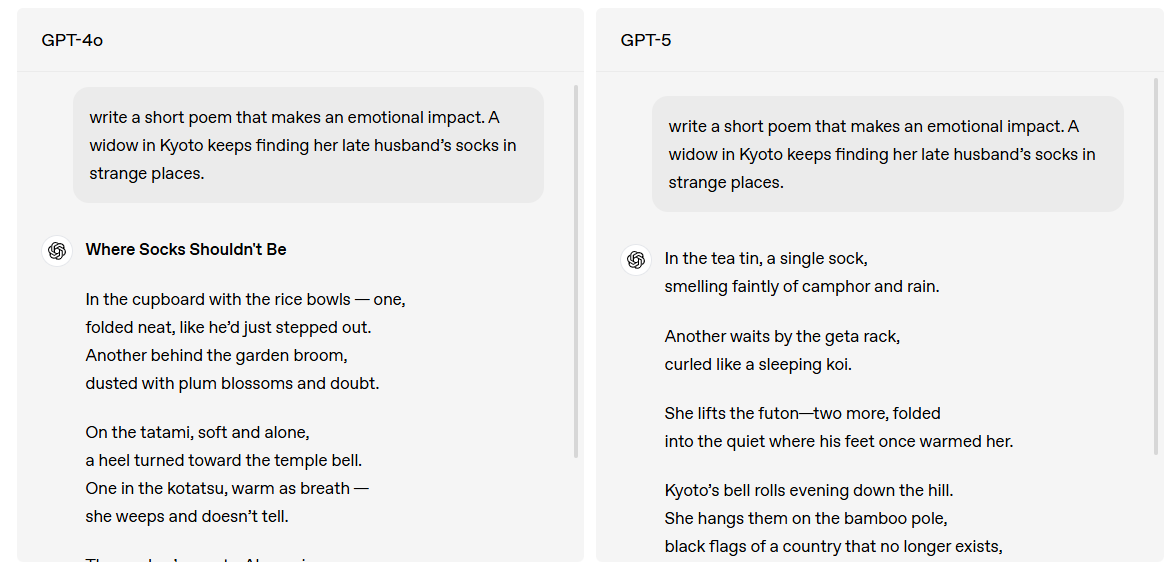

GPT-5 vs GPT-4o — comparatif synthétique

| Critère | GPT-4o | GPT-5 |

|---|---|---|

| Modalités | Texte, audio, image | Texte, audio, image, code + raisonnement profond. |

| Raisonnement | Bon, mais limité | Multi-étapes structuré, routage vers moteur de réflexion. |

| Fiabilité | Élevée | Supérieure (vérifications internes, baisse des hallucinations). |

| Personnalité | Chaleureuse, conversationnelle | Plus analytique ; options de personnalisation possibles. |

| Cas d’usage privilégiés | Conversation naturelle, multimodalité | Analyses complexes, tâches professionnelles, automatisation. |

Cette évolution ne remplace simplement pas l’expérience conviviale de GPT-4o : elle priorise la robustesse et la profondeur pour les usages exigeants.

Réactions et limites — retour d’expérience initial

Le lancement a aussi suscité des débats : certains utilisateurs ont exprimé leur attachement aux anciennes voix et aux comportements des modèles précédents, et des ajustements ont été officiels pour permettre un choix plus fin des profils de modèles. Par ailleurs, comme toute plateforme majeure, la montée en charge et les ajustements de quotas ont entraîné des critiques sur la gestion des limites d’accès pendant la période de basculement. OpenAI a reconnu ces retours et travaille à affiner l’expérience.

Disponibilité et tarification (points pratiques)

OpenAI a annoncé le déploiement progressif de GPT-5 : d’abord aux clients Team et Enterprise, puis à d’autres groupes d’utilisateurs ; l’API est ouverte aux développeurs avec les variantes mini/nano pour gérer coûts et latences. Les modalités exactes (quotas, tarification par token, options Pro/Plus) sont publiées sur les pages produit et peuvent évoluer rapidement selon les retours et la charge. Pensez à consulter la documentation officielle pour obtenir les paramètres à jour avant déploiement.

GPT-5 est présenté comme une étape majeure sur la route vers des systèmes de plus en plus « généraux » : attentes pour la mémoire longue durée, intégration en temps réel à des flux vidéo, personnalités adaptatives et meilleure interopérabilité avec des outils externes (bureautique, IDE, robots). OpenAI souligne cependant qu’il ne s’agit pas (encore) d’une AGI : le modèle n’apprend pas de manière continue en production et nécessite toujours des contrôles humains.

En bref

GPT-5 n’est pas simplement une itération : c’est une réorganisation architecturale qui combine rapidité, raisonnement profond et multimodalité dans un système capable d’adapter sa «pensée» au problème posé. Pour les entreprises et les créateurs, cela ouvre des possibilités inédites ; pour les utilisateurs, cela signifie des réponses plus fiables et pertinentes — à condition d’être attentif aux quotas, au choix du modèle et aux enjeux de sécurité.